Une bonne animation faciale est essentielle à la présence et au charisme d’un personnage à l’écran. Donner vie à un personnage est aussi la partie la plus compliquée. La mobilité d’un visage et la façon dont on lit l’expression sont complètement différentes de la manière dont le corps bouge et est perçu. C’est pourquoi nous avons consacré une grande partie du temps et des ressources de MocapLab à la recherche, aux travaux et aux projets expérimentaux, dans l’optique de maîtriser cette partie du travail et de contrôler la menace de l’Uncanny Valley.

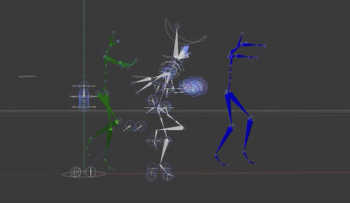

Sur ce terrain, le pipeline devient encore plus important. A partir d’un modèle scanné ou non, en passant par le rigging (en shape et bones), le retargeting, et tous les éléments présents dans l’image finale (incluant les textures, les displacements maps, le framing, le lighting, le rendu, le SSS…). C’est un domaine où une bonne synergie et une collaboration avec toutes les parties associées sont essentielles.

Nous avons débuté la motion capture faciale 20 ans auparavant chez Actisystem, avec l’acteur français Richard Bohringer dans le pilote du long métrage “20 000 lieues sous les mers” (IMAGINA Prix de la recherche, 1994). Chez Attitude Studio, en 2001, des avancées plus poussées ont été réalisées et sont visibles sur la parisienne virtuelle, Eve Solal. MocapLab, dans ses débuts en 2007-2008, a gagné un concours national de business start-up et a été récompensée par une subvention OSEO pour développer la R&D et finaliser les outils internes pour la capture faciale. MocapLab a depuis participé à beaucoup de projets avec diverses contraintes, offrant à l’équipe une vision claire des problèmes rencontrés et des solutions possibles.

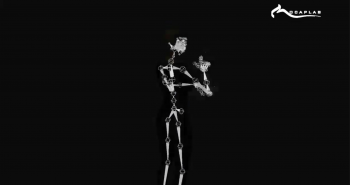

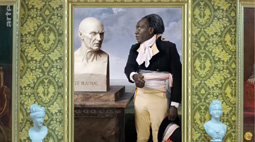

Autres projets de mocap faciale

Autres projets de mocap faciale